Como estamos ensinando algoritmos a serem homens e brancos

Cada vez mais nosso cotidiano é regido por algoritmos. Eles determinam as notícias e postagens que encontramos em nossas tinhas do tempo e os anúncios que recebemos, mas também, cada vez mais, têm impacto na nossa vida real, como a possibilidade de obter de crédito e até servindo como base para políticas de policiamento.

Uma das propostas tecnológicas mais promissoras da atualidade é o chamado “machine learning”, algoritmos que aprendem organicamente a serem mais eficientes. São máquinas que não são programadas, mas “ensinadas”, que aprendem observando o nosso comportamento. E, curiosamente, os algoritmos estão aprendendo preconceitos da mesma forma que muitas crianças aprendem: observando os pais.

Vale lembrar que ainda este ano a Microsoft precisou “matar” sua inteligência artificial que estava aprendendo a falar como uma “adolescente comum” no Twitter. Em 24h observando a rede social ela aprendeu a ser nazista e disse querer matar feministas. Além de, claro, a disposição muito maior de monstrinhos do game “Pokémon Go” em bairros ricos. Agora, uma recente matéria do NY Times também mostra diversos outros casos em que esse fenômeno acontece:

1. Negros taqueados como “gorilas” – No ano passado o aplicativo Google Photos, que aplica tags automáticas em fotos, estava classificando imagens de pessoas negras como “gorilas”. O Google precisou se desculpar e bloquear esse tageamento de seu algoritmo. Segundo a empresa, isso provavelmente se deu porque os testes de reconhecimento de imagens foram feitos muito mais com pessoas brancas.

2. Asiáticos sempre piscando – Da mesma forma, um software da Nikon classificava pessoas asiáticas como “piscando”, e outro da Hewlett-Packard encontrava dificuldade em reconhecer pessoas com tons de pele mais escuros. Novamente, a razão foi que os engenheiros que fizeram os testes eram majoritariamente brancos.

3. Negros previstos como “futuros criminosos” – Parece coisa de uma distopia de ficção científica, mas os EUA estão usando hoje um software para prever estatisticamente “futuros criminosos”. E o software está classificando muito mais pessoas negras como “alto risco” do que brancas.

4. Policiamento reforçado em bairros de minorias – Ainda na segurança pública, softwares estão sendo usados em cidades como Nova York, Los Angeles, Chigado e Miami para políticas de policiamento preventivo, prevendo onde os crimes podem aparecer para reforçar o policiamento. Isso perpetua um círculo vicioso em bairros tradicionalmente mais pobres ou de minorias, causando mais policiamento, portanto mais prisões e alimentando ainda mais o algoritmo a enfatizar esses bairros. Uma bola de neve.

5. Sem entrega expressa da Amazon em bairros negros – A Amazon norte-americana recentemente bloqueou as entregas de mesmo dia em CEPs de bairros predominantemente negros devido ao seu algoritmo de segurança. A empresa também teve que manualmente corrigir seu software.

6. Mulheres recebem menos anúncios de bons salários – Um estudo de anúncios do Google mostrou que mulheres recebem menos propostas de empregos de altos salários do que homens. Novamente alimentando a “bola de neve” de desigualdade salarial, já que recebem menos propostas de altos salários, portanto conseguem menos empregos de altos salários. A culpa também foi atribuída ao algoritmo “inteligente” de sugestão de ads.

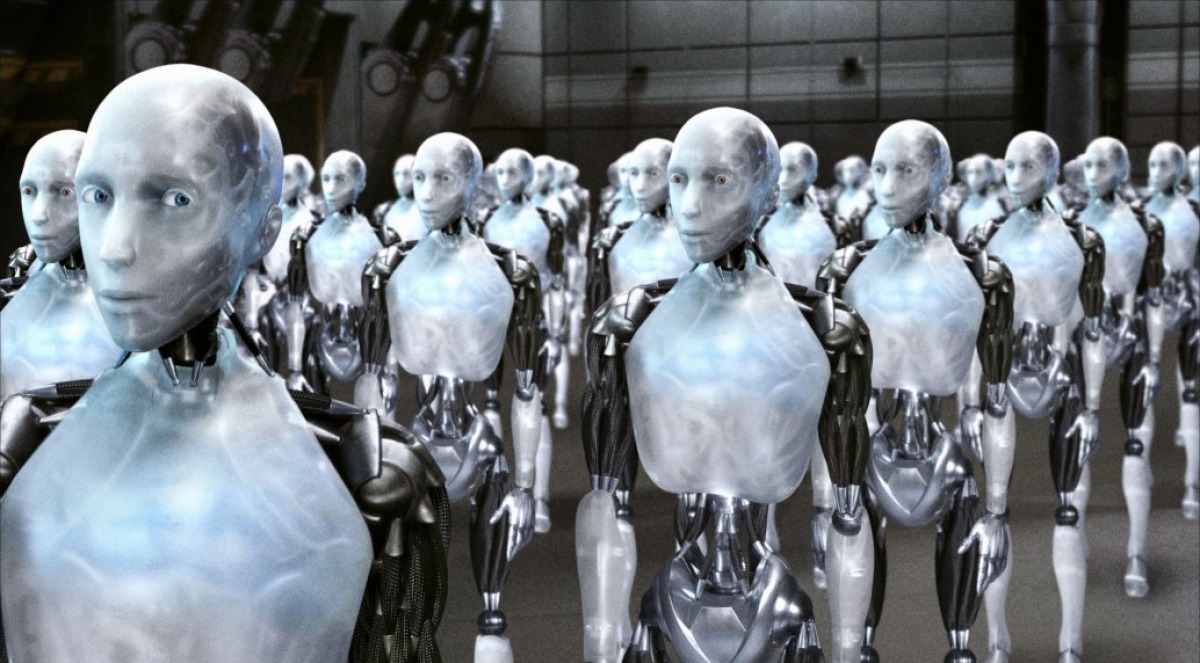

Esse olhar enviesado é particularmente preocupante considerando o papel cada vez maior que as “máquinas inteligentes” terão em nossas vidas, até com a discussão sobre se elas podem tomar a decisão de matar. Um tema comum na ficção científica é a ascensão de inteligências artificiais que revolucionam e subjugam a nossa sociedade. Mas talvez a grande ameaça das máquinas pensantes seja elas ajudarem a manter a nossa sociedade cada vez mais do jeitinho que ela está.