Google é criticado por banir termo ‘gorila’ após caso de racismo

O Google foi criticado por “consertar” seu algoritmo de reconhecimento de imagem racista simplesmente removendo a palavra “gorila” da ferramenta de “autotag”. O caso indignou muitos usuários em 2015 depois que imagens de dois amigos foram marcadas como as de primatas. Agora, quase três anos depois, a empresa “corrigiu” o problema bloqueando a identificação de gorilas, chimpanzés e macacos.

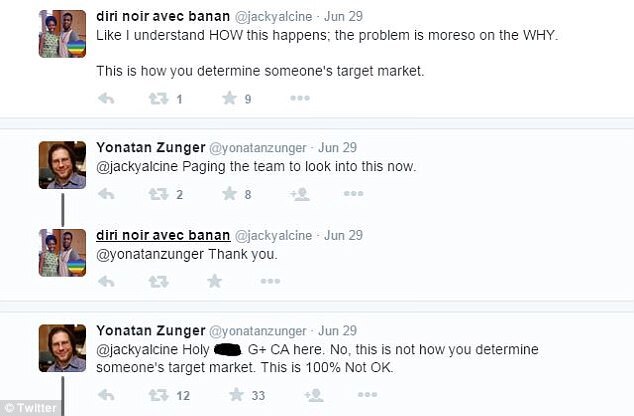

Usuários do Twitter criticaram a empresa por não trabalhar para desenvolver um modelo diversificado para um algoritmo e, em vez disso, apenas proibir a identificação de gorilas e pessoas negras.

O Google lançou seu aplicativo de fotos autônomo em maio de 2015, anunciando uma série de recursos, como a criação automática de coleções de pessoas e objetos, como alimentos ou paisagens. O Google Photos usa um recurso de marcação automática para ajudar a organizar imagens carregadas no serviço e facilitar a busca.

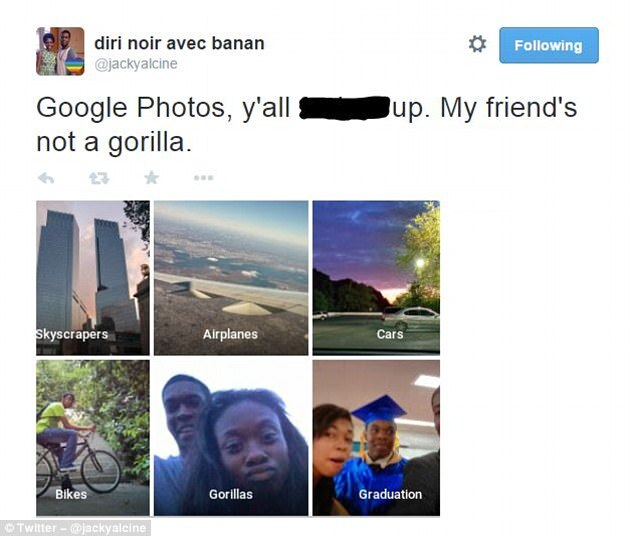

No entanto, pouco depois do lançamento do app, Jacky Alcine, do Brooklyn (em Nova York, nos EUA), surgiu em uma coleção como “gorila”.

O incidente causou indignação e o Google disse que estava “consternado” e se desculpou pelo erro.

No fim do ano passado, a “Wired” testou fotos do Google usando 40 mil imagens –muitas das quais continham animais. Muitos bichos foram identificados, como pandas e saguis. No entanto, o sistema não conseguiu identificar gorilas, chimpanzés ou macacos.

Um porta-voz confirmou que o termo “gorila” foi censurado após o incidente de 2015 e “chimpanzé” e “macaco” tinham sido bloqueados também. “A tecnologia de rotulagem de imagem ainda é nova e, infelizmente, não está perto de ser perfeita”, disse.

“Que tal fazer o esforço para desenvolver uma base de modelo diversificada (por exemplo, não toda branca) para o algoritmo?”, tuitou Agustín Fuentes, um professor de antropologia dos Estados Unidos.

Com informações do Daily Mail